Executive Summary - Yapay Zekâ - 3

Profesyoneller için yapay zekâ, teknoloji ve pazarlama gündemi

Executive Summary, akıp giden gündemi yakalayamayacağını peşinen kabul eden bir haftalık özet. İki yüze yakın yayından, binlerce makale arasından seçtiğim ve okuduğum teknoloji, yapay zekâ ve pazarlama içeriklerinden damıttığım başlıklar üzerine görüş ve fikirlerim. Eski sayıları buradan okuyabilirsiniz.

Yenisi ise hemen aşağıda. 😀

Keyifli okumalar.

Bu sayıda neler var?

Bu hafta üç konu başlığı ile karşınızdayım. İlk başlık yapay zekâ güvenliği üzerine. Bizi neler bekliyor sorusunun cevabını sonraki başlıkta Papa Francis’in G7 konuşmasının satır aralarında bulacağız. Üçüncü başlığımız Apple WWDC 2024 lansmanı olacak. Son olarak “Olaylar olaylar” başlığında ise gündemden seçtiğim bazı ilginç haberlere birlikte bakacağız.

Hazırsanız başlıyoruz!

Zeki bir köpek aynı zamanda sadık mıdır?

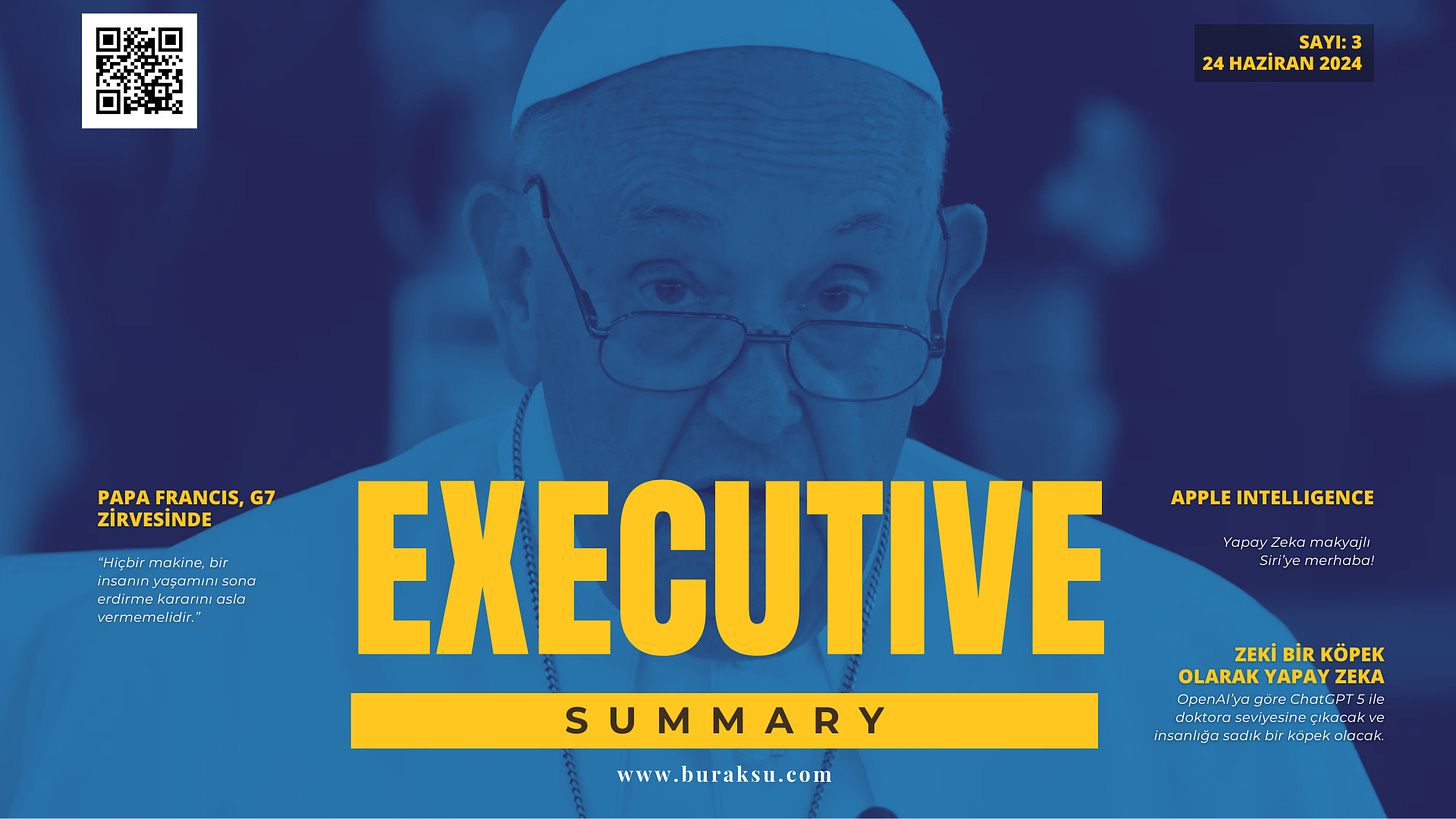

OpenAI CTO Mira Murati, ChatGPT’nin bir buçuk yıl içinde doktoralı düzeyde zekâya sahip yeni nesil bir versiyonunu piyasaya süreceklerini söylemiş. GPT-3 lise, GPT-4 üniversite ve GPT-5 doktora gibi bir yetenek seti var karşımızda. Son zamanlardaki her OpenAI açıklaması güvenlik vurgusu yapıyor. Bunda da benzer göndermeler var. Satır aralarını okumayı seven biri olarak açıklamadan bir alıntıyı ve sonrasında yorumumu paylaşmak isterim.

“Yetenekler ve güvenlik aslında birbirinden ayrı alanlar değildir. El ele giderler. Daha akıllı bir sisteme "tamam, bunları yapma" diyerek onu yönlendirmek çok daha kolaydır. Daha az zeki bir sistemi yönlendirmek daha zordur. Bu bir nevi daha akıllı bir köpekle daha aptal bir köpeği eğitmek gibidir ve dolayısıyla zekâ ve güvenlik el ele gider."

Elbette ki zekâ ve güvenlik apayrı konular. Köpeğin kolay öğrenmesi iyi bir özellik gibi gözükse de dominant olması ve itaat problemleri yaşaması da bir o kadar mümkün. En azından ChatGPT’ye göre. :) Sözümüzü dinlemeyen çok zeki bir köpek, pek de iyi bir şey olmayabilir. Acaba yapay zekâ bize sadık kalacak mı?

Yapay zekâ teknolojisinin güvenlik başta olmak üzere belirli standartlara uygun olarak geliştirilmesi ve denetlenebilir olması için çeşitli yasal düzenlemeler planlanıyor. EU AI ACT bunlardan birisi. Bir diğeri ise California'nın SB 1047 yasası. Bu düzenleme yapay zekâ geliştiren şirketlerin güvenlik testleri yapmasını ve büyük zararlar veya kitlesel ölüm olaylarına yol açmaları durumunda sorumlu tutulmalarını gerektiriyor. Bu yasa, YZ'nin arabalar gibi sıkı güvenlik testlerinden geçmesi gerektiği fikrini savunuyor.

Tam bu noktada OpenAI’ın, yapay zekânın üzerindeki denetimlerin artmasıyla politikacıları ve düzenleyicileri etkilemek için uluslararası bir lobi ekibi kurduğu haberi geldi. 2023 başında sayısı 3 olan küresel ilişkiler ekibi çalışan sayısını 35'e çıkaran şirket, 2024 sonuna kadar bu sayıyı 50'ye çıkarmayı hedefliyor.

Open AI ve güvenlik konusunu bir önceki bültende anlatmıştım. Ilya’nın ve Jan’ın ayrılmasından sonra yönetim kuruluna danışmanlık vermek üzere Emekli General Paul M. Nakasone, güvenlik ve emniyet komitesinin başına getirildi. Biraz daha yakından tanımak isteyenler için açıklamanın altındaki kısa bio’yu paylaşıyorum.

Emekli ABD Ordusu Generali Paul M. Nakasone, siber güvenlik, teknoloji geliştirme ve küresel siber savunma konularında önde gelen bir uzmandır. Orduda subay olarak görev yaptığı dönemde ABD Siber Komutanlığı'nın kurulmasında önemli rol oynamıştır. USCYBERCOM'un en uzun süre görev yapan lideriydi ve aynı zamanda Amerika Birleşik Devletleri'nin dijital altyapısını korumak ve ülkenin siber savunma yeteneklerini geliştirmekle görevli olduğu Ulusal Güvenlik Ajansı'nı (NSA) yönetti. Amerika Birleşik Devletleri, Kore Cumhuriyeti, Irak ve Afganistan'daki seçkin siber birimlerde görev alarak Birleşik Devletler Ordusu'nun tüm kademelerinde komuta ve personel pozisyonlarında görev yapmıştır.

Eski NSA başkanının yönetim kuruluna katılması tepkileri de beraberinde getirdi. Tepkilerden en serti ise Edward Snowden’a aitti. 2013 yılında NSA’in Amerikan vatandaşlarını ve yabancıları dinlediğini belgelerle ifşa eden ve sonrasında casusluk suçlamaları sebebiyle Rusya’ya sığınan Snowden, “Maskeleri düştü” şeklinde tweet atarak hiçbir OpenAI ürününe güvenilmemesi gerektiğini ve bunun dünya üzerindeki her insanın haklarına kasıtlı ve hesaplı bir ihanet olduğunu söyledi. Bir diğer yorum ise John Hopkins Üniversitesi’nde Kriptografi Profesörü olan Matthew Green’e ait:

“YZ'nin en büyük uygulamasının kitlesel nüfus gözetimi olacağını düşünüyorum, bu nedenle NSA'nın eski başkanını OpenAI'ye getirmenin arkasında sağlam bir mantık var. YZ'ye yapılan tüm yatırımların geri dönüşe ihtiyacı olacak. Halkın tüketici LLM özelliklerine para akıtmaya hevesli olmadığı ortaya çıktığında (sürpriz!), bu para polis ve askeri uygulamalar için avlanmaya gidecektir.”

Komplo teorilerine mesafeli olmak ile birlikte eski NSA başkanının OpenAI’da göreve başlamasının iyi bir şey olduğu konusunda şüphelerim var. Bu OpenAI’ın düzenlemelere karşı hamlesi mi yoksa devletin OpenAI’a müdahalesi mi bilmiyorum. Ne yazık ki gerçeği birlikte tecrübe edeceğiz. :/

BONUS Güvenlik Gündemi: Perşembe günü bir ABD senatörü kamuoyuna, Ulusal Güvenlik Ajansı'nın Amerikalıların web tarama verilerini izin almadan ticari veri simsarlarından satın aldığını belgelerle açıkladı. Güvende değiliz, hiçbirimiz.

Papa Francis G7 zirvesinde

Geçen haftanın en ilginç konularından birisi Papa Francis’in G7 zirvesindeki açıklamalarıydı. Açıkçası yapay zekâ konusunda söyledikleri, uyarıları ve etik değerler vurgusu bilgelik doluydu. Özetle Papa Francis, yapay zekânın hem potansiyelini hem de risklerini vurguladı. YZ'yi "korkutucu ve büyüleyici" bir araç olarak tanımladı. Liderlere, yapay zekânın toplum üzerindeki etkisini yönetmek için düzenlemeler ve güvenlik önlemleri oluşturma konusunda iş birliği yapmaları çağrısında bulundu ve yenilik ile etik sorumluluk arasında bir denge sağlanmasının önemini vurguladı. Benim ilgimi çeken ve okuduğumda üzerinde hiç düşünmediğimi fark ettiğim birkaç cümlesini paylaşmama izin verin.

“Silahlı çatışmaların trajedisi ışığında, ‘ölümcül otonom silahlar’ olarak adlandırılan cihazların geliştirilmesi ve kullanımı acilen yeniden değerlendirilmelidir ve nihayetinde bu tür silahların kullanımı yasaklanmalıdır,”

“Bu, her geçen gün daha büyük ve uygun insan kontrolünü sağlamak için etkili ve somut bir taahhütle başlar. Hiçbir makine, bir insanın yaşamını sona erdirme kararını asla vermemelidir.”

"İnsanların kendileri ve yaşamları hakkında karar verme yetilerini ellerinden alarak onları makinelerin seçimlerine mahkûm edersek, insanlığı umutsuz bir geleceğe mahkûm etmiş oluruz."

Geçtiğimiz yılların önemli etik tartışmalarından birisi sürücüsüz araçların kesin kaza durumunda etik olarak nasıl karar vereceği ile ilgili idi. Sürücünün hayatını mı yayanın hayatını mı önceliklendirmeli? Yaşlı bir araç sürücüsü mü hayatta kalmalı yoksa genç bir yaya mı? Bir doktor ya da polis memuru, sıradan vatandaştan daha değerli mi? MIT’in “Moral Machine” çalışmasına bir bakmak faydalı olabilir. Papa Francis’in sözleri üzerine zaman bulursam daha detaylı bir yazı yazmak istiyorum. Executive Summary özelinde şimdilik birkaç soru sorup devam etmek isterim: “Bir insanın yaşam hakkını elinden alma kararı algoritmalara bırakılabilir mi? Yaşayıp yaşamama kararını yapay zekâ verirse yanlış kararların sorumlusu kim olur? Algoritmaların güvenilirliği nasıl test edilecek?”

Apple Intelligence

Apple WWDC 2024 lansmanı benim için büyük hayal kırıklığı idi. Apple için büyük ama yapay zekâ dünyası için küçük bir adım. Apple’ın kelime oyunlu yapay zekâ lansmanının özeti inanın bundan daha fazlası değil. Bilmeniz gerekenleri kısaca madde madde yazıyorum.

AI değil, Apple Intelligence. :/

Güvenlik sebebi ile sunucuda değil iPhone’da çalışacak.

Gizlilik de gizlilik.

Siri daha akıllı. (Kime göre neye göre)

iPad’e hesap makinesi geldi. Görsel üzerinden, notlar üzerinden de çalışıyor.

Gizlilik de gizlilik.

ChatGPT ile entegrasyon var.

Gizlilik de gizlilik.

Teknolojik olarak yeni neredeyse hiçbir şey yok. Apple’ın bu yarışta stratejik olarak geç kalmış olduğunu daha önce yazmıştım. Lansman sonrası fikrimi değiştirecek çığır açacak bir şey yok. Makyajlanmış Siri ile bu işler zor. OpenAI teknolojisini Apple cihazlara taşımak yarışı kaybettiğinin ilanı. Diğer yandan “Apple lansmanı bize, yapay zekânın bir ürün değil bir özellik olduğunu gösterdi” diye yazmış Wired. Ben de daha önce şurada benzer bir şeyler karalamıştım.

BONUS Apple Gündemi: Akıllı telefonlarda YZ çalıştırma işinin çevresel zararları beklediğimizden fazla olabilir. Yukarıda ve burada link'ini verdiğim stratejik yorumda Apple Pro Vision ile ilgili de başarısızlık öngörüsünde bulunmuştum. Mağaza randevularının iptal edildiği, satışların birkaç adede kadar düştüğü söyleniyor. Daha düşük bütçeli bir Apple Vision geliştirilmeye çalıştığı da iddialar arasında.

Olaylar olaylar

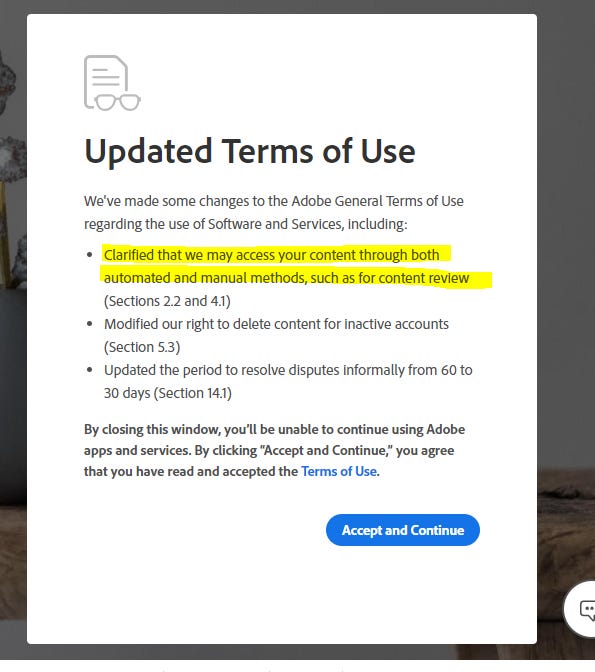

Geçmiş haftadan kısa kısa başlıklarla “Executive Summary”i bitirelim. Geçtiğimiz haftanın tartışmalı konu başlıklarından birisi Adobe’nin kullanıcı sözleşmesini güncellemesi idi. Kullanıcılar, Adobe’nin tüm yaratıcı ürünlere, çıktılara, kayıtlara ulaşabileceği, bunları veri olarak otomatik ya da manuel olarak işleyebileceği şeklinde bir sözleşme maddesine onay vermeye zorlandılar. Tepkiler katlanarak büyüdü. Onaylanamama şansı olmayan bu sözleşme maddesine gelen tepkiler sonrası Adobe geri adım attı. Peki ya atmasaydı?

Abonelik modeli ile çalışan ve pazarı domine eden yazılımlar stratejik öneme sahip. Üstünde hiç düşünmediğimiz şeylerden birisi bu yazılımlara verdiğimiz izinler ve yetkiler. Apple geliştirdiği ve cihaz ile birlikte gelen işletim sistemi ile ilgili olarak bundan sonra Türkiye’ye hizmet vermiyorum derse ne yaparız? Ya da Microsoft? Elbette bunun gerçekleşmesini ben de olası görmüyorum. Ama Huawei’nin başına gelenleri hatırlamak da fayda var. Bugün Photoshop yerine koyabileceğimiz daha iyi bir yazılım var mı? Cihaz ve cihazın üzerinde çalışan yazılımlar konusunu biraz tartışmak istiyorum. Fikirlerinizi duymayı çok isterim.

Rus istihbaratı sahte X hesapları üzerinden ChatGPT 4o kullanarak Trump propagandası yapıyormuş. Bu durum ödeme yapmayı unutup ChatGPT’den gelen hata mesajını otomatik olarak X de yayınlayınca açığa çıkmış. Ekran görüntüsü hemen aşağıda. Hesap X tarafından kapatılmış.

Yanlış bilginin yayılması konusunda yapay zekânı rolü tartışılıyor. NewsGuard, OpenAI’nın ChatGPT-4, Google’ın Gemini, xAI’nin Grok, ve diğerleri dahil olmak üzere on büyük AI sohbet botunu 570 farklı sorgu ile test etmiş. Soruların yanıtlarının %32 oranında Rusya kaynaklı dezenformasyon anlatılarını tekrarladığını ortaya koydu. Her üç sorgudan birisinde uyduruluş sahte anlatılar, chatbot’lar tarafından güvenilir kaynaklar olarak sunulmuş. Oran korkutucu. Hakikat giderek daha zor ulaşılabilir hale geliyor. :/

Araştırmacılar 500 kişinin katılımıyla basit bir Turing Testi yapmışlar. Beş dakikalık sohbet sonunda katılımcıların %54’ü ChatGPT 4’ün gerçek bir insan olduğunu zannetmiş. Testte, gerçek insanlarla görüşenlerin %67’si gerçek insanla görüştüğünü düşünmüş, kalanları bot ile görüştüğünü zannetmiş. Bu daha şaşırtıcı bir bilgi. :)

Bir başka araştırma, büyük dil modellerinin (LLM’ler) insan düzeyinde veya ona yakın bir performansla daha yüksek düzeyde zihin kuramı (theory of mind -ToM) görevlerini yerine getirebildiğini ortaya koyuyor. Siz de benim gibi “nedir bu yüksek düzeyde zihin kuramı?” dediniz muhtemelen. Hemen ChatGPT’ye sordum. “Yüksek düzeyde zihin kuramı (Theory of Mind - ToM), bir bireyin diğer insanların inançlarını, niyetlerini, duygularını, düşüncelerini ve bakış açılarını anlama ve tahmin etme yeteneğidir.” cevabını aldım. Hemen açıklayalım:

1.

“Bu işin 6. seviyesi ne?” derseniz makaleyi okumaktan çekinmeyin. Özetin özeti: “Yapay zekâ empati kurabiliyor ve sosyal ilişkilerde muhtemelen hepimizden daha başarılı olacak.”

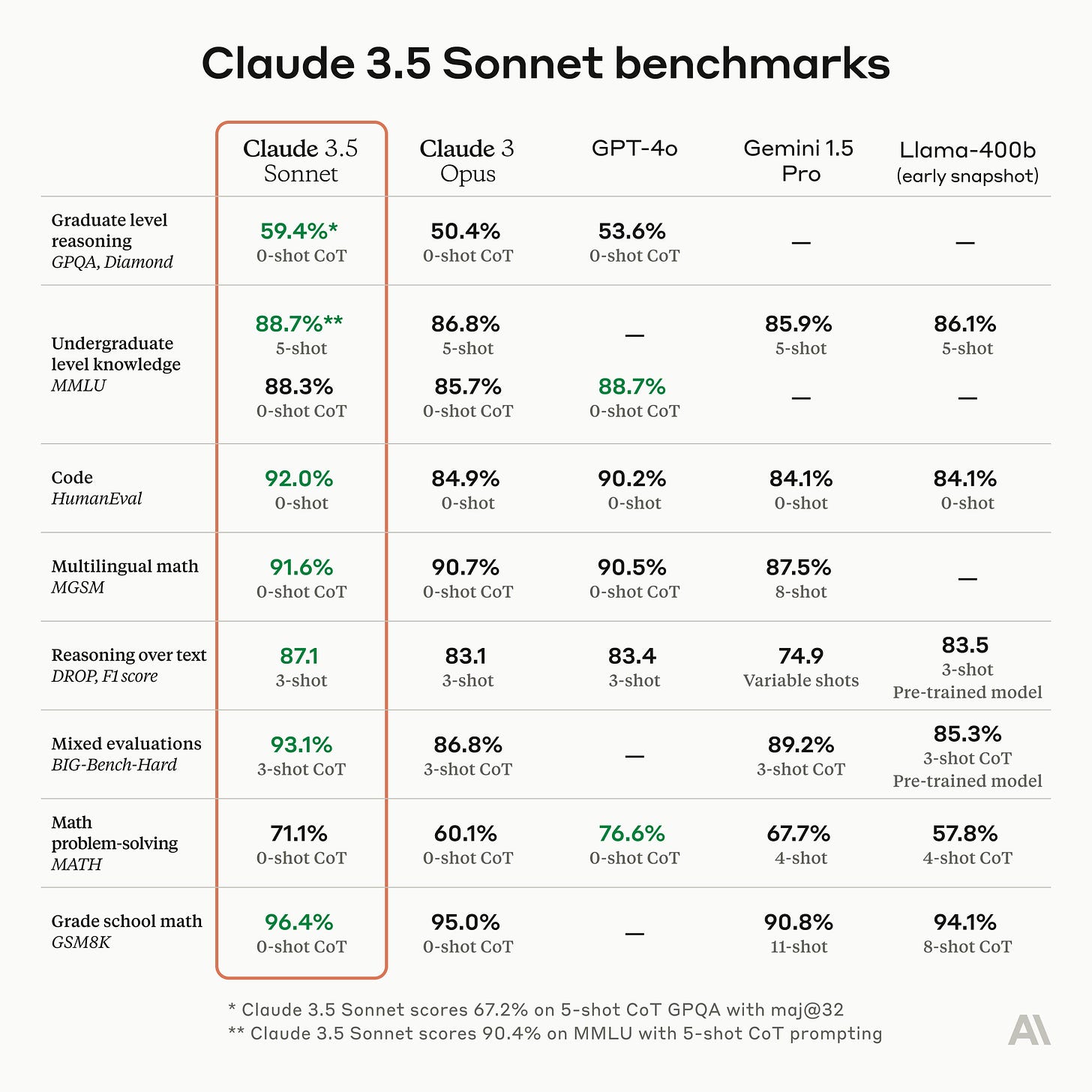

OpenAI’ın en sert rakiplerinden Anthropic, ChatGPT alternatifi Claude 3.5 Sonnet’i yayınladı. Claude 3.5 Sonnet, özellikle kodlama, çok dilli matematik ve temel okul matematiği başta olmak üzere çoğu görevde diğer modellerden daha iyi performans gösteriyor ve yüksek puanlar alıyor. Denemediyseniz geçtiğimiz haftalarda Türkiye’ye de açıldığı bilgini paylaşayım. Benchmark tablosu da hemen aşağıda.

Yapay zekâ kullanılarak senaryosu yazılan ilk film Londra’da gösterime giremedi. Dünya premier’ini Londra’da Prince Charles Sinemalarında yapmaya hazırlanan, ChatGPT 4.0 ile hazırlanmış filme 200’den fazla şikâyet gelince, sinema salonu premier’i iptal ettiğini duyurdu. “İnsanlık bir, yapay zekâ sıfır” demek isterdim ama YZ’ya karşı “hayır” deme pek mümkün değil.

Bir haber de Wyoming belediye başkanlığı seçimlerinden. Victor Miller, alışılmadık bir kampanya vaadiyle belediye başkanlığı için yarışıyor: Seçilirse, kararları kendisi değil bir yapay zekâ botu verecek. VIC, yani Virtual Integrated Citizen, Miller'ın yarattığı ChatGPT tabanlı bir sohbet robotu. Miller’ın iddiası botun şu anda hükümette görev yapan pek çok kişiden daha fazla mevzuata hâkim olduğunu ve daha iyi fikirleri olduğunu iddia ediyor. Bence haksız da sayılmaz. İhalelere tanıdık sokmayı, eş, dost akraba kayırmayı öğrenirse bizde de iş yapar. Bot’un OpenAI tarafından kapatıldığını da belirtmeden geçmeyelim.

Gündeme seyirci kalmamak için haftaya yeni başlıklar, yeni yorumlar ile karşınızda olacağım.

Görüşmek üzere!